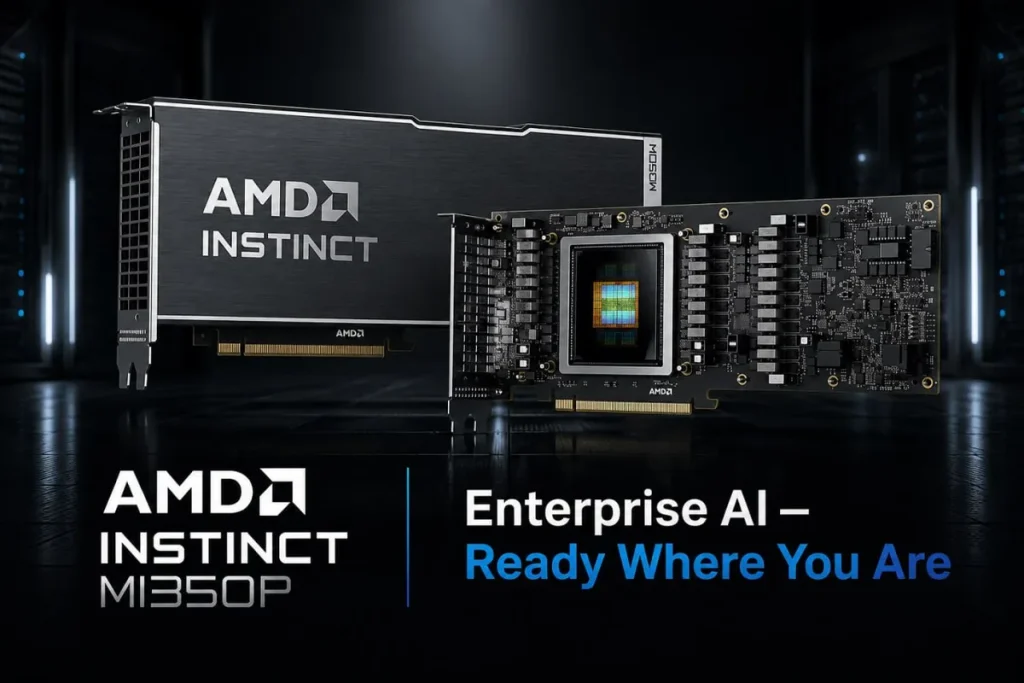

AMD ha presentado la AMD Instinct MI350P, su primera GPU PCIe orientada a IA en varios años. Llega con 144 GB de HBM3E, un consumo de hasta 600W y una cifra pico de 4.6 PFLOPs en MXFP4. El dato importa porque no se limita a un formato nuevo: devuelve Instinct al terreno de las tarjetas dual-slot para servidores estándar.

La propuesta apunta a empresas que quieren ampliar su capacidad de cómputo sin rehacer la infraestructura. AMD habla de una tarjeta pensada para despliegues on-premises, sobre la red eléctrica, refrigeración y bastidores ya existentes. La AMD Instinct MI350P también entra en un tramo del mercado donde PCIe sigue mandando por coste y facilidad de integración.

En paralelo, la compañía sitúa este modelo dentro de su gama AI compute con soporte para formatos de menor precisión como MXFP6 y MXFP4, además de aceleración por sparsity en precisiones de 8 y 16 bits. Sobre el papel, eso la coloca como una pieza muy específica para inferencia y cargas empresariales de IA, no como una GPU generalista.

144 GB HBM3E y 4.6 PFLOPs para servidores PCIe

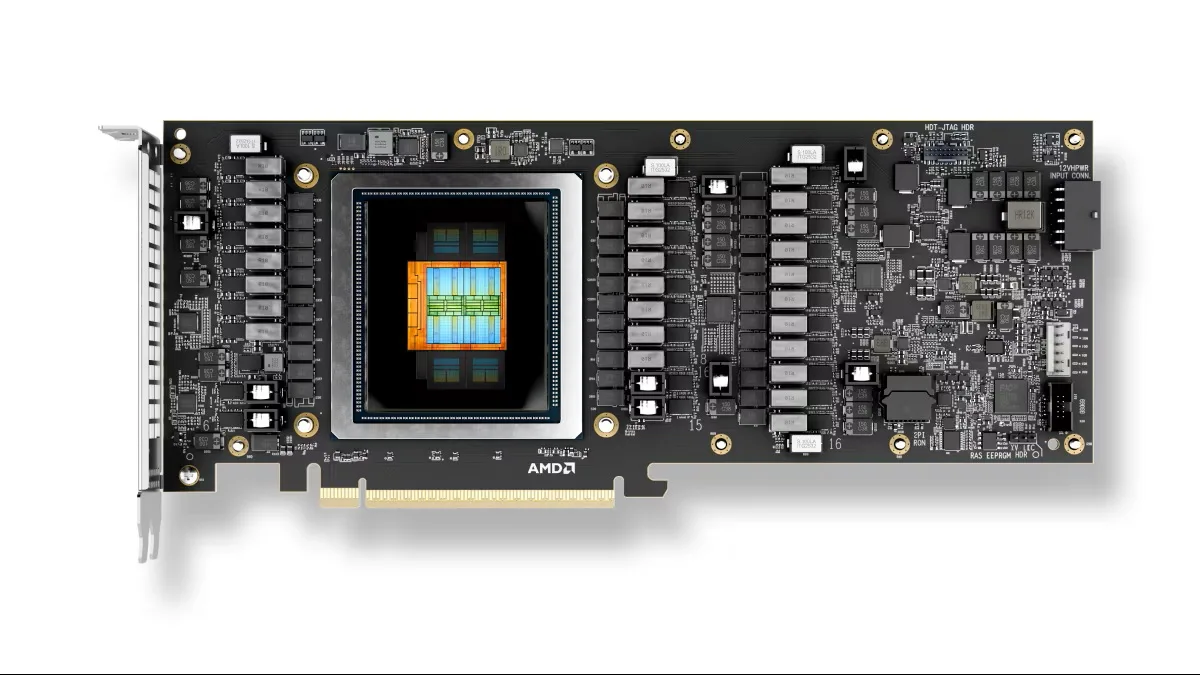

La ficha técnica de la AMD Instinct MI350P parte de la arquitectura CDNA 4 y del proceso de 3 nm de TSMC. El chip llega en una configuración de 4 XCD, la mitad que la MI350X, y suma 128 compute units, 8.192 stream processors y 512 Matrix cores. Su reloj máximo se sitúa en 2.200 MHz y el conjunto integra 73.000 millones de transistores.

La memoria es otro de los puntos centrales. AMD monta 128 MB de Infinity Cache y 144 GB de HBM3E sobre un bus de 4.096 bits, con un ancho de banda de 4 TB/s. Frente a la MI350X, que asciende a 288 GB de HBM3E y un bus de 8.192 bits, la MI350P recorta capacidad, pero mantiene una base muy alta para un formato PCIe.

El diseño físico también está pensado para ese entorno: 10,5 pulgadas de longitud, refrigeración pasiva y conector de 16 pines para llegar a un TBP de 600W, con opción de bajarlo a 450W. En un mercado donde la densidad térmica marca el ritmo, ese detalle pesa tanto como la cifra de cómputo.

AMD Instinct recupera el PCIe frente al H200 NVL

AMD coloca la MI350P frente a la H200 NVL de NVIDIA, la última aceleradora PCIe de la competencia con 141 GB de HBM3E y el chip Hopper H200. También entra en la conversación la RTX PRO 6000 Blackwell Server Edition, aunque esa tarjeta usa el GB202 y no el GB200, que es el formato de servidor de verdad. En ese marco, la comparación ya no va solo de memoria, sino de cómo se empaqueta la potencia dentro de una ranura PCIe.

La propia AMD da varias cifras para situarla: 2,299 TFLOPS estimados, hasta 4,600 TFLOPS pico en MXFP4, 2.3 PFLOPs FP16 con sparsity y 2.30 PFLOPs BFloat16 con sparsity. Son números pensados para inferencia empresarial, justo donde los formatos de menor precisión ganan peso frente a otras cargas más clásicas.

La AMD Instinct MI350P ya está disponible a través de distintos socios y llega con soporte para ROCm y un stack de software descrito como abierto para empresa. Que vuelva al PCIe después de años sin un diseño así no cambia por sí solo el mercado, pero sí devuelve a AMD una pieza que encaja en centros de datos que no quieren saltar directamente a infraestructura propietaria o más costosa. Ahí está el matiz: menos memoria que la MI350X, sí, pero también una ruta de adopción más directa para despliegues de IA en servidores estándar.

En esa misma línea, ya vimos movimientos de AMD alrededor de su gama Instinct en otros frentes, como la llegada del MI450 a clientes de IA, lo que deja ver que la familia sigue ganando peso en la estrategia de centro de datos.

ROCm, socios y una oferta más amplia para IA empresarial

El lanzamiento también encaja con la idea de ampliar el catálogo de AMD para empresas que avanzan a ritmos distintos en su adopción de IA. No todas necesitan el mismo nivel de integración, ni el mismo presupuesto, ni la misma densidad térmica. Por eso una tarjeta PCIe dual-slot como la MI350P tiene un papel distinto al de las configuraciones más grandes.

La combinación de MXFP6, MXFP4, sparsity y HBM3E la sitúa en una zona muy concreta del mercado profesional. AMD no solo está enseñando más rendimiento bruto; está intentando cubrir un formato que llevaba tiempo sin una actualización de este nivel dentro de Instinct. Y eso, en centros de datos, suele importar más que la cifra aislada.

El siguiente paso ya está marcado por la distribución a través de socios y por la adopción del stack ROCm en entornos empresariales. Desde ahí se medirá si este regreso al PCIe se traduce en despliegues reales, algo que dependerá menos de la ficha y más de cómo encaje en infraestructuras ya desplegadas.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ

Es una GPU aceleradora PCIe de AMD orientada a cargas de IA para empresa. Usa arquitectura CDNA 4 y formato dual-slot para servidores estándar.

Integra 144 GB de HBM3E sobre un bus de 4.096 bits. AMD indica un ancho de banda de hasta 4 TB/s.

La tarjeta llega a un TBP de 600W y puede configurarse hasta 450W. AMD usa un conector de 16 pines para cubrir ese consumo.

AMD la sitúa frente a la H200 NVL, que ofrece 141 GB de HBM3E. También entra en la comparación con la RTX PRO 6000 Blackwell Server Edition.