La ambición de convertir a los asistentes en algo más que una capa de conversación empieza a tomar forma concreta en Android. Google no solo quiere que hables con Google Gemini; quiere que actúe dentro de tus aplicaciones, ejecute tareas reales y conecte servicios sin que tengas que abrirlos uno a uno. Ahora la compañía explica cómo funcionará esa arquitectura en el sistema.

El movimiento no es superficial. Supone redefinir la relación entre apps y asistentes, con un modelo que se ejecuta en el propio dispositivo y que busca equilibrar automatización y control.

AppFunctions: el puente local entre apps y agentes

La primera pieza se llama AppFunctions, una función de plataforma integrada en Android 16 junto a una librería Jetpack asociada. Su planteamiento es directo: permitir que las aplicaciones expongan capacidades concretas para que agentes como Gemini puedan invocarlas de forma estructurada y local.

Google compara este sistema con el Model Context Protocol (MCP) usado en entornos de agentes, pero con una diferencia sustancial: aquí las acciones ocurren en el dispositivo Android, no en servidores externos. Eso implica menor latencia y un mayor control sobre los datos.

El funcionamiento se basa en que el desarrollador describa qué puede hacer su app —crear tareas, generar listas, buscar contenido, añadir eventos— como si fueran “herramientas” disponibles para el asistente. Cuando el usuario formula una petición, el agente identifica la función adecuada y la ejecuta con los parámetros ya interpretados.

Los ejemplos que maneja Google son ilustrativos:

- Crear un recordatorio a las 17:00 en una app de tareas.

- Generar una playlist con los mejores discos de jazz del año.

- Buscar una receta concreta en el correo y añadir ingredientes a la lista de la compra.

- Añadir un evento al calendario sin abrir manualmente la aplicación.

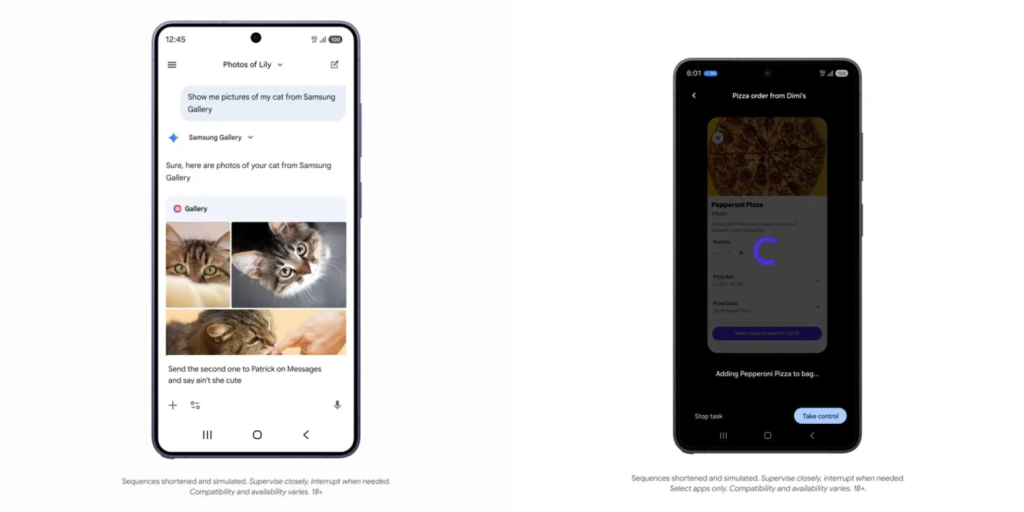

En dispositivos como el Samsung Galaxy S26, Gemini ya puede interactuar con la galería para mostrar fotos bajo demanda sin salir de su propia interfaz. También está previsto su despliegue en equipos con One UI 8.5 o superior.

Además, Google confirma que la app de Gemini ya utiliza AppFunctions para integrarse con calendario, notas y tareas en aplicaciones propias y en configuraciones por defecto de fabricantes.

Segunda vía: automatización de interfaz sin integración dedicada

No todas las apps tendrán, al menos de inicio, funciones declaradas mediante AppFunctions. Para cubrir ese vacío, Google desarrolla un marco de automatización de interfaz (UI automation) que permitirá a agentes ejecutar tareas genéricas dentro de aplicaciones instaladas.

Aquí el peso recae en la plataforma. En vez de exigir código adicional a cada desarrollador, Android interpreta la interfaz y simula interacciones inteligentes. Es una vía de adopción rápida para ampliar el alcance del asistente sin obligar a una integración profunda desde el primer momento.

Este sistema ya se ha dejado ver en anuncios relacionados con la nueva generación de dispositivos Galaxy y con la futura serie Pixel. La expansión más amplia llegará con Android 17, que ampliará el acceso a fabricantes y desarrolladores.

El mensaje de Google es claro: el asistente no debe limitarse a responder preguntas, sino ejecutar acciones reales entre aplicaciones. AppFunctions ofrece una integración ordenada y predecible; la automatización UI cubre el resto mientras el ecosistema madura.

Si este modelo prospera, Android podría convertirse en un entorno donde el usuario interactúa menos con iconos y más con intenciones. La transición no será inmediata, pero la infraestructura ya está definida. Lo que queda ahora es comprobar cuántas aplicaciones deciden abrir sus funciones a esta nueva capa de interacción.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ

Es una función de Android 16 que permite a las apps exponer acciones concretas para que asistentes como Gemini las ejecuten localmente.

AppFunctions requiere integración estructurada por parte del desarrollador; la automatización UI permite acciones sin integración dedicada.

No. AppFunctions está diseñado para funcionar en el propio dispositivo Android.

Los equipos con Android 16, incluidos modelos recientes como el Galaxy S26, y más adelante dispositivos con Android 17.

Para usar AppFunctions sí deben definir funciones específicas; con la automatización UI pueden beneficiarse sin cambios profundos.