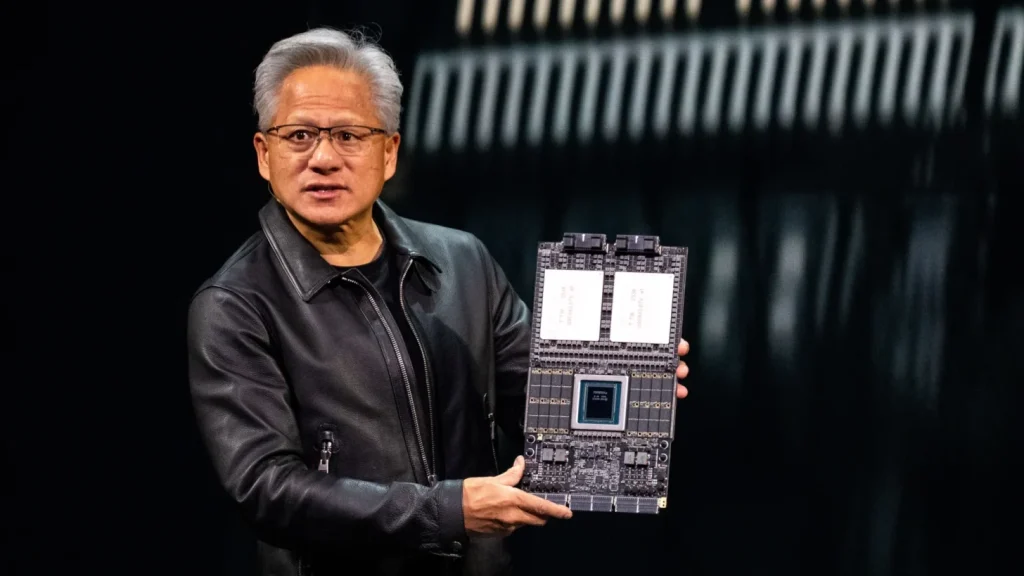

Los planes de NVIDIA para con las unidades LPU de Groq han sido el combustible de innumerables debates en los mentideros de la industria. No ha sido hasta la reciente llamada de resultados del cuarto trimestre de 2026 cuando Jensen Huang ha decidido soltar prenda. Con un tono que mezclaba la seguridad del que sabe que tiene un as bajo la manga y la expectación propia de una víspera de GTC, el CEO de la firma verde ha trazado un paralelismo histórico que lo cambia todo. No estamos ante una simple suma de chips. Por el contrario, estamos ante la pieza que faltaba para que la inteligencia artificial deje de «pensar» y empiece a «reaccionar» en tiempo real. En todo este contexto, la adquisición de Groq por NVIDIA se revela como una pieza clave dentro de la estrategia AI.

El «Efecto Mellanox» llega a la fase de inferencia

La adquisición de Groq por NVIDIA estrategia AI (o más bien, el acuerdo milmillonario de colaboración y exclusividad) tiene un objetivo cristalino: aniquilar la latencia. Durante la charla con analistas, Jensen Huang comparó este movimiento con la compra de Mellanox hace años. Si aquella adquisición resolvió el problema del «cuello de botella» en las redes de los centros de datos mediante InfiniBand, la integración de las LPU de Groq busca hacer lo propio con el decode de los modelos de lenguaje.

La idea es simple pero ambiciosa: extender la arquitectura de NVIDIA utilizando a Groq como un acelerador especializado. En el panorama actual, donde hemos dominado el entrenamiento con arquitecturas como Blackwell, el nuevo campo de batalla es la inferencia de agentes. Estos «enjambres» de IA necesitan razonar en milisegundos para ser útiles en entornos críticos. Es ahí donde las LPU, con su ancho de banda interno de decenas de terabytes por segundo gracias a su memoria SRAM integrada, marcan la diferencia. Por cierto, en este nuevo escenario, se observa cómo la estrategia AI de NVIDIA gira en torno a la adquisición de Groq.

Racks híbridos y el futuro de la arquitectura Rubin

Lo que veremos en el próximo GTC promete ser el inicio de una nueva jerarquía en el datacenter. Las especulaciones más sólidas apuntan a la presentación de los «LPX racks», unidades capaces de albergar hasta 256 LPU de Groq trabajando en absoluta sincronía. Por si fuera poco, la integración no se limitará a chasis separados. Se espera que NVIDIA implemente NVLink Fusion para gestionar el volcado masivo de caché KV desde las GPUs hacia las unidades de Groq. Esto optimizará la fase de pre-relleno y decodificación de datos. Así, la estrategia AI de NVIDIA tras la adquisición de Groq toma protagonismo en el futuro del hardware.

- Inversión de récord: Se estima que el acuerdo alcanza los 20.000 millones de dólares, la mayor apuesta financiera de los de Santa Clara hasta la fecha.

- Feynman en el horizonte: Para 2028, los rumores sugieren que podríamos ver unidades LPU integradas mediante hybrid bonding directamente en los chips de las GPUs de próxima generación (Feynman). Este avance sería una consecuencia lógica de la estrategia AI de NVIDIA tras la adquisición de Groq.

- El mercado manda: Con unos ingresos que ya crecen al 1:1 con la computación, NVIDIA necesita que la capa de aplicación de la IA sea instantánea para mantener su dominio.

Lo mejor de todo es que esta estrategia no solo consolida a la serie Rubin CPX, sino que prepara el terreno para un ecosistema donde múltiples agentes de IA colaboren entre sí sin esperas. NVIDIA no solo está vendiendo palas para la mina de oro de la IA. Ahora está vendiendo la infraestructura para que el oro se procese a la velocidad de la luz. En este contexto, el modelo de adquisición de Groq por NVIDIA se siente como una pieza estratégica en AI.

¿Quién quiere esperar un segundo?

En el ajedrez de silicio que juega Jensen Huang, Groq es el movimiento que pone en jaque al tiempo mismo. Si Mellanox fue la columna vertebral que conectó los cerebros de NVIDIA, Groq será el sistema nervioso que permita que esos cerebros respondan antes de que termines la pregunta. En la era de la IA, el que duda (o tarda un milisegundo de más) está fuera del juego. Por último, no hay duda de que la estrategia AI de NVIDIA ha cambiado con la adquisición de Groq.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ: El impacto de Groq en el ecosistema de NVIDIA

¿Qué significa que NVIDIA use a Groq como un «acelerador»? Significa que las unidades LPU de Groq no sustituirán a las GPUs de NVIDIA, sino que trabajarán junto a ellas encargándose específicamente de las tareas de baja latencia, como la generación de texto (decode) en modelos de IA. La acquisición de Groq por NVIDIA estrategia AI busca crear un sistema híbrido ultraeficiente.

¿Por qué es tan importante la baja latencia en la IA actual? Con el auge de los agentes de IA que deben tomar decisiones autónomas o interactuar con humanos en tiempo real, cualquier retraso (latencia) rompe la experiencia o la utilidad del servicio. Groq elimina este problema, y claramente la nueva estrategia de AI engloba la adquisición por NVIDIA.

¿Qué diferencia hay entre las LPU de Groq y las GPUs tradicionales? A diferencia de las GPUs que usan memoria HBM, las LPU utilizan SRAM, lo que permite un ancho de banda interno muchísimo mayor, ideal para procesar tareas de inferencia de forma secuencial y rapidísima. Es aquí donde la estrategia AI de NVIDIA se perfecciona gracias a la adquisición de Groq.

¿Cuándo veremos los primeros productos de esta colaboración? Jensen Huang ha citado a todo el sector para el próximo GTC, donde se espera que se presenten soluciones de rack-scale que integren ambas tecnologías. Además, la adquisición de Groq por NVIDIA será fundamental en la estrategia AI de cara a estos nuevos productos.

¿Cómo afecta esto a los usuarios comunes? Aunque es una tecnología de servidor, el resultado final será que las IAs que usamos a diario (chatbots, asistentes de voz, herramientas de codificación) responderán de manera instantánea, casi humana, sin el «lag» actual. Así pues, la estrategia AI de NVIDIA tras la adquisición de Groq también beneficiará a los usuarios finales.