RTX AI suma Hermes, un agente diseñado para funcionar en local sobre RTX PCs, estaciones RTX PRO y DGX Spark. NVIDIA lo presenta como una base para agentes que se ejecutan de forma continua, con mejora propia y tareas encadenadas. El foco está claro: llevar este tipo de cargas al hardware del usuario, no al servidor remoto.

La noticia importa por dos frentes. Hermes ya supera los 140.000 estrellas en GitHub en menos de tres meses y, según OpenRouter, es el agente más usado del mundo desde la semana pasada. Además, llega acompañado de Qwen 3.6, una familia de modelos abiertos que NVIDIA sitúa como adecuada para este uso local. La combinación apunta a un escenario muy concreto: más agente, más ejecución en el dispositivo y menos dependencia de grandes configuraciones en la nube.

La base técnica también condiciona el mensaje. Qwen 3.6 35B funciona con unos 20 GB de memoria, mientras que modelos de más de 120.000 millones de parámetros requieren más de 70 GB. En paralelo, Qwen 3.6 27B iguala la precisión de modelos de 400.000 millones de parámetros como Qwen 3.5 397B, pero con una huella una dieciseisava parte menor. Son cifras que explican por qué NVIDIA insiste tanto en su hardware para acelerar este tipo de inferencia.

Hermes gana terreno porque escribe sus propias habilidades y separa mejor las tareas

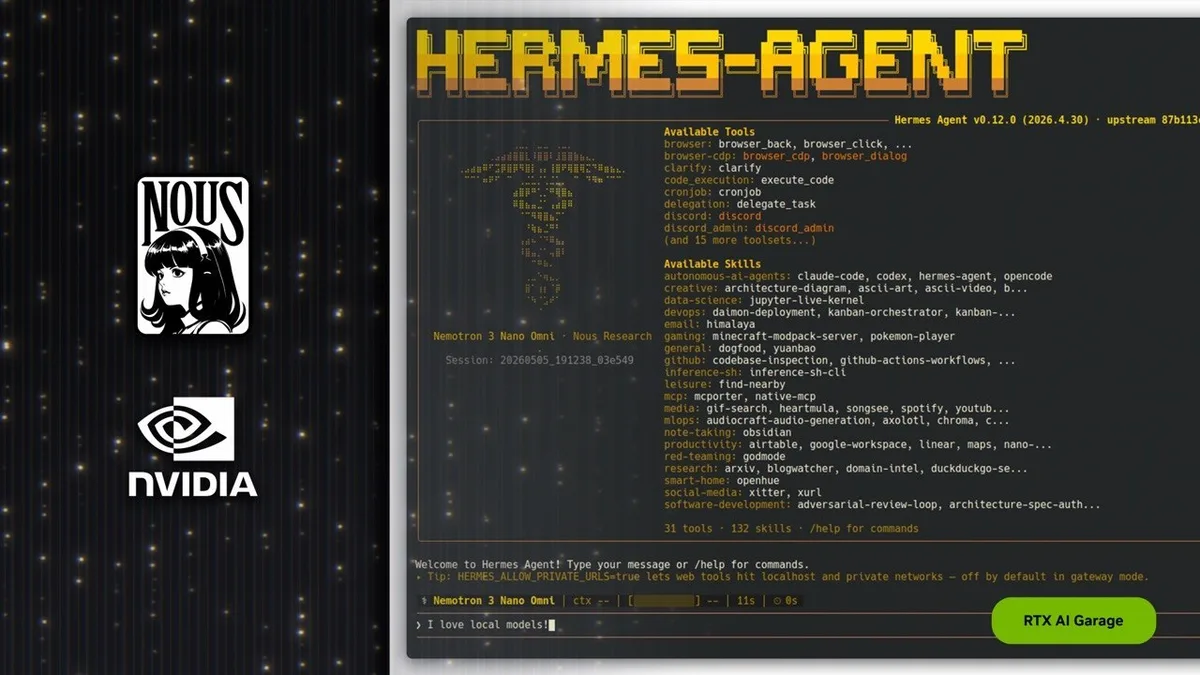

Hermes, desarrollado por Nous Research, se apoya en cuatro rasgos que NVIDIA subraya como diferenciales. El primero es la capacidad de escribir y refinar sus propias habilidades cada vez que afronta una tarea compleja o recibe feedback. El segundo pasa por los subagentes contenidos: pequeños trabajadores aislados, con contexto y herramientas limitados, para evitar que el flujo se desordene.

Los otros dos pilares son la fiabilidad y el rendimiento frente al mismo modelo base. Nous Research dice que revisa y somete a pruebas de estrés cada habilidad, herramienta y complemento antes de publicarlos. También sostiene que, usando modelos idénticos en distintos marcos, Hermes ofrece resultados superiores porque no actúa como un simple envoltorio, sino como una capa de orquestación persistente. Eso encaja con el tipo de uso que NVIDIA quiere impulsar en RTX AI en GeForce RTX: ejecución local, respuesta rápida y tareas que no dependen de ir pidiendo turno a un servidor.

La otra parte del cuadro es la operación continua. Hermes está pensado para integrarse con apps de mensajería, acceder a archivos locales y aplicaciones, y seguir activo 24/7. Para eso, NVIDIA remarca que las GPU RTX están diseñadas para estas cargas y que los Tensor Cores aceleran la inferencia para reducir latencia y aumentar el rendimiento. El matiz es importante: el agente puede ser local, pero su experiencia final depende mucho del margen de cálculo disponible.

Qwen 3.6 y 128 GB en DGX Spark empujan el uso local hacia modelos más grandes

DGX Spark entra aquí como la máquina pensada para ese uso sostenido. NVIDIA habla de un equipo compacto, autónomo y diseñado para jornadas completas de trabajo con agentes. Sus datos son bastante claros: 128 GB de memoria unificada y 1 petaflop de rendimiento en IA, suficiente para ejecutar modelos Mixture-of-Experts de 120.000 millones de parámetros durante todo el día.

La comparación con Qwen 3.6 vuelve a ser relevante porque el nuevo 35B promete una inteligencia equivalente con menos memoria y más margen para cargas concurrentes. También el 27B resulta atractivo para este tipo de flujos, ya que reduce el tamaño sin ceder precisión frente a modelos muchísimo mayores. En la práctica, RTX AI se mueve justo ahí: modelos más contenibles, agentes persistentes y hardware que pueda sostenerlos sin depender de una infraestructura externa enorme.

NVIDIA indica que DGX Spark puede pedirse ya a través de sus socios de fabricación, mientras que Hermes se puede descargar desde GitHub y ejecutar con llama.cpp, LM Studio u Ollama. El agente incluye soporte para LM Studio y Ollama desde el inicio, así que la integración queda bastante alineada con el software local que ya usan muchos desarrolladores. El siguiente paso pasa por ver cómo aterrizan estos agentes en el uso real, pero la dirección está marcada: RTX AI quiere que la inferencia y la orquestación de agentes vivan cada vez más cerca del PC.

En ese tablero, Hermes funciona como escaparate de una idea bastante precisa: menos latencia, más control y modelos abiertos ajustados al hardware local. Si la promesa de Qwen 3.6 y DGX Spark se sostiene en pruebas independientes, el foco se moverá de la nube al escritorio con bastante más fuerza.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ

Hermes añade un agente local que escribe y mejora sus propias habilidades, trabaja con subagentes aislados y puede operar de forma continua. NVIDIA lo vincula a RTX PCs, RTX PRO y DGX Spark para ejecutar estas tareas en el propio hardware.

Qwen 3.6 es la familia de modelos que NVIDIA presenta como adecuada para correr Hermes en local. El 35B funciona con unos 20 GB de memoria y el 27B reduce mucho el tamaño frente a modelos mucho mayores.

DGX Spark incorpora 128 GB de memoria unificada y 1 petaflop de rendimiento en IA. NVIDIA lo plantea como una máquina pensada para agentes que trabajan todo el día y para cargas concurrentes más exigentes.

NVIDIA indica que Hermes se puede usar con llama.cpp, LM Studio u Ollama. Además, el agente incluye soporte para LM Studio y Ollama desde el primer momento, lo que simplifica el despliegue local.