Claude AI suma una función llamada «dreaming» en Managed Agents. Anthropic la ha presentado en su conferencia Code with Claude y la coloca, por ahora, en vista previa de investigación. La compañía también duplicará los límites de uso de cinco horas para los planes Pro y Max de Claude Code.

La noticia importa por dos frentes. Por un lado, Anthropic empuja a sus agentes hacia una memoria más útil en trabajos largos y con varios sistemas trabajando a la vez. Por otro, responde a la presión de usuarios que venían chocando con límites de uso demasiado ajustados y con una infraestructura que no siempre ha ido al ritmo de la demanda.

La combinación deja una foto bastante clara: más capacidad para proyectos extensos y más margen para quienes usan Claude Code a diario. No hablamos de un cambio menor de interfaz. Hablamos de cómo la plataforma decide qué recuerda, qué olvida y cuánto puede usarse antes de topar con el límite.

Claude AI prueba «dreaming» para ordenar memorias entre agentes

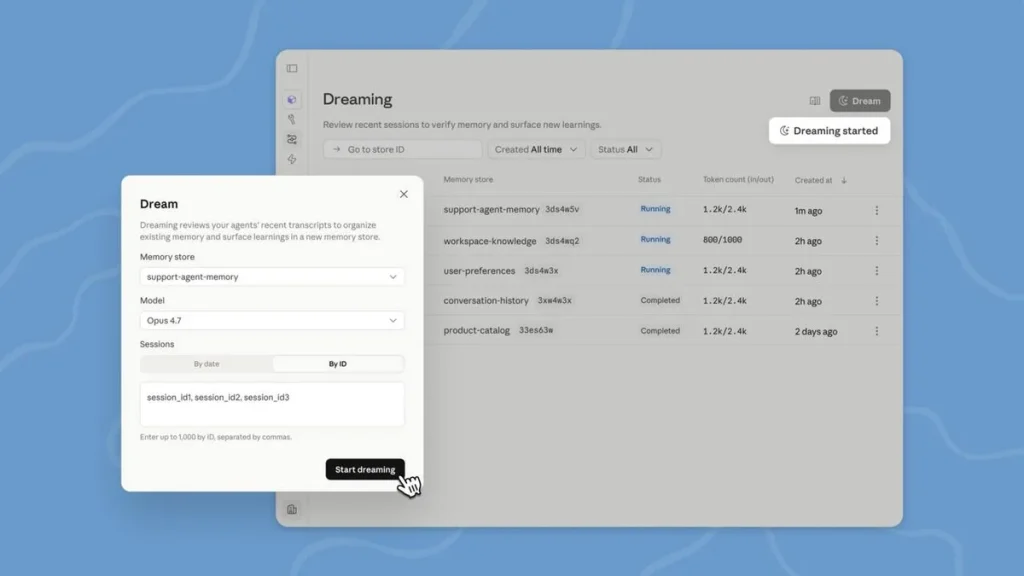

Anthropic define «dreaming» como un proceso programado que revisa sesiones recientes y almacenes de memoria para curar recuerdos concretos. La idea es extraer patrones que sirvan para tareas futuras, incluyendo errores repetidos, flujos de trabajo que convergen y preferencias compartidas dentro de un equipo. En la práctica, intenta que la memoria siga siendo útil cuando el trabajo se alarga.

Eso tiene sentido en un entorno donde los context windows siguen siendo limitados. Si un proyecto se estira durante horas o se reparte entre varios agentes, parte de la información importante puede quedar fuera. Anthropic ya usa compaction en el lado del chat, pero aquí el salto está en que «dreaming» opera de forma periódica entre sesiones y entre agentes, no solo dentro de una conversación aislada.

La compañía permitirá dos modos: automático o revisión manual de los cambios de memoria. El matiz no es pequeño. En flujos de trabajo complejos, decidir qué entra en memoria puede ser tan importante como la propia ejecución del agente, sobre todo cuando varios procesos comparten objetivos durante minutos u horas.

Como ya vimos en la filtración de Claude Code, el nombre Auto Dream ya había aparecido en el radar. Ahora Anthropic lo formaliza, al menos en esta versión de investigación para Managed Agents.

Pro y Max doblan el límite de cinco horas mientras Anthropic ajusta Claude Code

Junto con «dreaming», Anthropic ha ampliado la disponibilidad de dos funciones de vista previa que ya había mostrado: outcomes y multi-agent orchestration. Son piezas que encajan con el mismo enfoque, porque apuntan a automatizar tareas más largas y con más dependencias entre agentes.

La otra medida tiene impacto directo en el uso diario. Anthropic doblará los límites de cinco horas para sus suscriptores Pro y Max en Claude Code. La explicación que da la empresa es bastante concreta: está respondiendo a la frustración de usuarios mientras su infraestructura de cómputo intenta ponerse al nivel de la demanda. Es una forma de reconocer que el cuello de botella no estaba solo en el producto, sino también en la capacidad de servirlo.

En paralelo, Anthropic abre la puerta a más desarrolladores para pedir acceso a «dreaming», aunque no lo libera para todo el mundo. Eso encaja con una fase de prueba controlada, donde la compañía puede observar cómo se comporta la memoria entre agentes antes de extenderla más allá de Managed Agents.

El movimiento también se entiende mejor si se mira el pulso con el resto del sector. En nuestra cobertura de GPT-5.5 y Claude ya se veía cómo las interfaces de IA empiezan a parecerse menos a chats sueltos y más a entornos de trabajo continuado. Claude AI empuja ahora en esa dirección con una memoria más selectiva, agentes más coordinados y menos margen para perder contexto en proyectos largos.

La consecuencia práctica es doble: más ambición técnica en Managed Agents y más holgura para quienes usan Claude Code con frecuencia. Anthropic no ha abierto aún «dreaming» a todos los desarrolladores, pero sí ha dejado claro el rumbo: menos conversación efímera y más memoria organizada para tareas que no terminan en una sola sesión.

FAQ sobre Claude AI y «dreaming»

Anthropic ha presentado «dreaming» en Code with Claude como una función para Managed Agents, todavía en vista previa de investigación. Además, va a duplicar los límites de cinco horas en Pro y Max de Claude Code.

La función revisa sesiones recientes y almacenes de memoria para guardar patrones útiles, errores repetidos y preferencias compartidas. Su objetivo es mantener memoria de calidad en trabajos largos y con varios agentes.

No. Por ahora está limitada a Managed Agents en la Claude Platform y requiere acceso bajo solicitud. Anthropic no la ha abierto a todos los desarrolladores.

Anthropic ha ampliado la disponibilidad de outcomes y multi-agent orchestration. Son dos funciones de vista previa que ahora llegan a más usuarios dentro del mismo enfoque de trabajo multiagente.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ

Es un proceso programado que revisa sesiones recientes y almacenes de memoria para conservar información útil. Anthropic lo plantea como una forma de extraer patrones para tareas futuras en Managed Agents.

De momento, solo en Managed Agents dentro de la Claude Platform y en vista previa de investigación. Anthropic además indica que el acceso se puede solicitar.

Anthropic va a duplicar los límites de uso de cinco horas para esos planes. La empresa lo vincula a la demanda y a la presión sobre su infraestructura de cómputo.

Ha hecho más accesibles outcomes y multi-agent orchestration, dos funciones que ya estaban en vista previa. Las dos encajan con el uso de varios agentes trabajando sobre una misma tarea.