El AMD Instinct MI450 aparece asociado a un posible acuerdo con Anthropic, según rumores que apuntan a que la firma de IA incorporará estos aceleradores en sus servidores. La referencia no llega sola: el movimiento se enmarca en un mercado donde conseguir capacidad de cómputo sigue siendo el cuello de botella. Y AMD ya había dejado claro que tiene varios clientes de escala “OpenAI” alineados para sus aceleradores Instinct.

La noticia importa por dos motivos. Primero, porque Anthropic ya trabaja con GPUs de NVIDIA, Amazon Trainium y, tras su alianza con Google y Broadcom, también tendrá acceso a TPUs. Segundo, porque si este encaje se confirma, AMD sumaría otro cliente de peso para su línea de IA justo cuando la industria sigue limitada por la cadena de suministro. Eso explica que los grandes jugadores estén repartiendo sus necesidades entre varios proveedores.

Anthropic suma varias rutas de cómputo y AMD entra en la lista

Según la fuente, Anthropic planea incorporar los próximos aceleradores AMD Instinct MI450 en sus servidores. No es un detalle menor: la compañía ya ha cerrado una alianza estratégica con Google y Broadcom para disponer de varios gigavatios de capacidad TPU a partir de 2027. En paralelo, también mantiene acceso a otras plataformas de IA, lo que dibuja una estrategia de aprovisionamiento bastante diversificada.

Ese reparto de cargas encaja con el momento actual del sector. Cuando la demanda aprieta y la oferta no acompaña, las empresas de IA no dependen de un solo proveedor. Reparten pedidos, combinan arquitecturas y buscan cualquier vía para asegurar infraestructura. En ese mapa, AMD gana visibilidad con una familia de aceleradores que quiere entrar en centros de datos a gran escala.

Ya vimos esta presión por disponibilidad en otros movimientos recientes, como la demanda que rodea al Ryzen 9 9950X3D2 en China, donde el precio acabó marcando la conversación. Aquí el contexto es distinto, pero la lógica es parecida: cuando el hardware se convierte en recurso escaso, cada anuncio pesa más de lo normal.

La familia MI400 apunta a 40 PFLOP, 432 GB de HBM4 y 19.6 TB/s

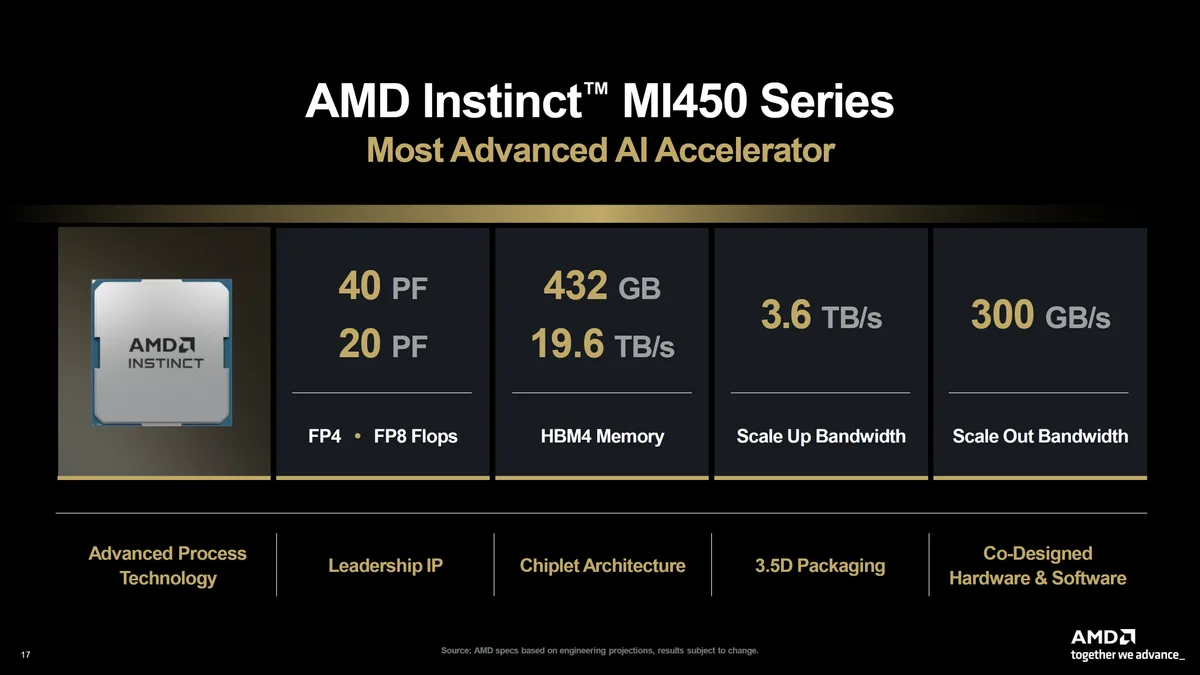

AMD situará esta generación en la serie Instinct MI400, con variantes MI450X y MI430X basadas en la arquitectura CDNA 5. La hoja técnica citada por la fuente habla de 40 PFLOP en FP4 y 20 PFLOP en FP8, el doble de la capacidad de cómputo de la serie MI350. También añade memoria HBM4, con un salto de 288 GB a 432 GB, es decir, un 50% más de capacidad.

El ancho de banda también sube con fuerza: 19.6 TB/s, frente a los 8 TB/s de la MI350. A eso se suma un enlace scale-out de 300 GB/s por GPU y funciones de rack-scale networking basadas en UALoE, UAL y UEC. Sobre el papel, AMD intenta competir en memoria, ancho de banda y escalado, justo donde se juegan los despliegues de IA más grandes.

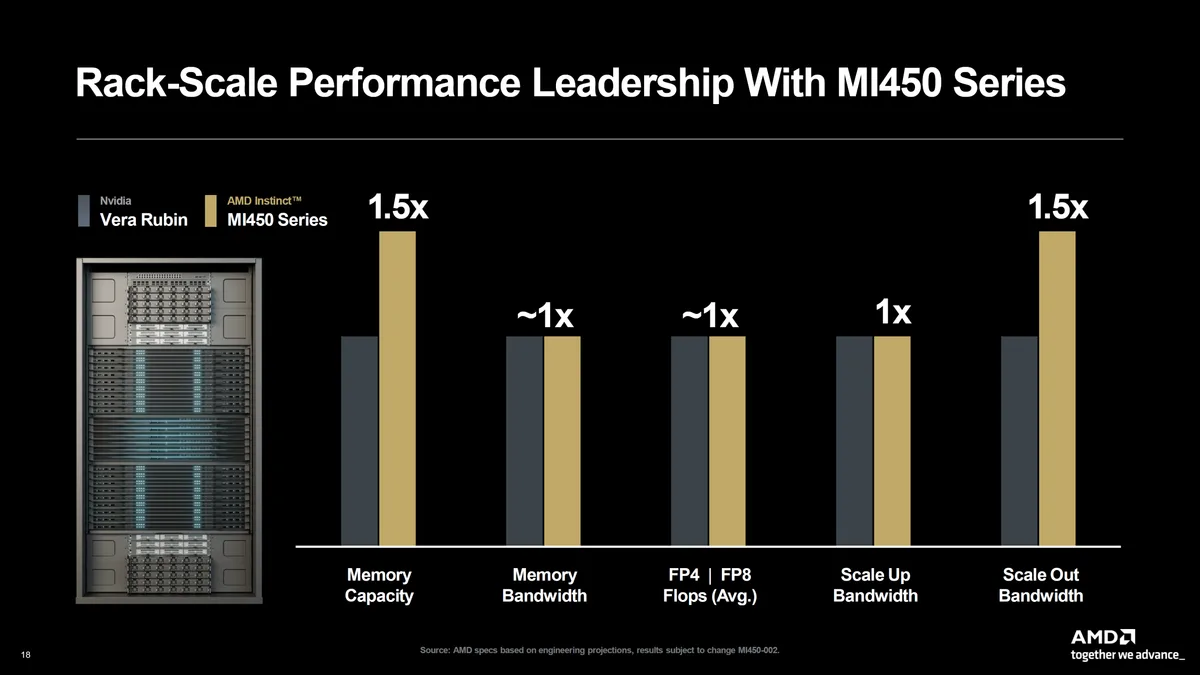

La comparación que circula coloca a la MI400 frente a NVIDIA Vera Rubin con una ventaja en capacidad de memoria de 1.5x y un ancho de banda scale-out también 1.5x superior, aunque con paridad en FP4/FP8, scale-up y ancho de banda de memoria. Falta ver cómo aterriza todo esto en productos comerciales, pero el mensaje de AMD es bastante claro: quiere más sitio en los racks de IA, y un cliente como Anthropic reforzaría esa posición cuando la generación MI450 empiece a ganar tracción.

Fuera del terreno de los rumores, AMD también ha anunciado colaboración con el Gobierno francés para apoyar su estrategia nacional de IA, ampliar el acceso a recursos de cómputo abiertos y respaldar la infraestructura ligada a Alice Recoque, el primer superordenador exascala de Francia. La foto que deja esta noticia es nítida: AMD empuja su oferta de IA por varios frentes a la vez, desde los grandes acuerdos hasta el despliegue institucional.

La presión por chips explica por qué la AMD Instinct MI450 gana peso

El caso de Anthropic sirve como termómetro del sector. La disponibilidad manda más que nunca, y por eso un posible cliente grande para el AMD Instinct MI450 tiene tanta lectura estratégica. Si el acuerdo se concreta, AMD sumará un respaldo relevante para su próxima generación de aceleradores, mientras la demanda de IA sigue repartida entre GPU, TPU y ASIC.

La clave ahora está en el calendario. AMD lanzó la serie MI400 como una familia pensada para 2026, mientras que parte de la nueva capacidad de Anthropic con Google y Broadcom no se espera hasta 2027. Entre ambos hitos, el mercado seguirá midiendo quién logra asegurar más cómputo antes y con qué arquitectura. Esa es la verdadera batalla.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ

La fuente indica que Anthropic podría incorporar los aceleradores AMD Instinct MI450 en sus servidores. Por ahora se trata de rumores, no de un anuncio oficial.

La fuente cita 40 PFLOP en FP4, 20 PFLOP en FP8, 432 GB de HBM4 y 19.6 TB/s de ancho de banda. También habla de un enlace scale-out de 300 GB/s por GPU.

La presión sobre la cadena de suministro empuja a las empresas de IA a repartir sus pedidos entre varios proveedores. Eso explica que Anthropic combine NVIDIA, Amazon Trainium, TPUs de Google y, potencialmente, AMD.

La propia cita de Anthropic habla de capacidad TPU de nueva generación a partir de 2027. Esa fecha aparece separada del despliegue de la familia MI400 de AMD, previsto para 2026.