Apple lleva años cocinando a fuego lento su entrada en el mercado de las gafas inteligentes, las ya bautizadas por el imaginario colectivo como Apple Glass. Lo que se perfila en el horizonte no es solo un gadget para presumir de diseño. Más bien, es un dispositivo que apunta directamente a la línea de flotación de las Ray-Ban de Meta. Según ha revelado Mark Gurman en su reciente boletín dominical, estas gafas serán capaces de capturar fotos, vídeo y gestionar llamadas. Sin embargo, su verdadera razón de ser reside en algo mucho más ambicioso que una simple montura con cámara: el despliegue total de la visión computacional integrada en el ecosistema.

Una tríada de hardware para alimentar a Apple Intelligence

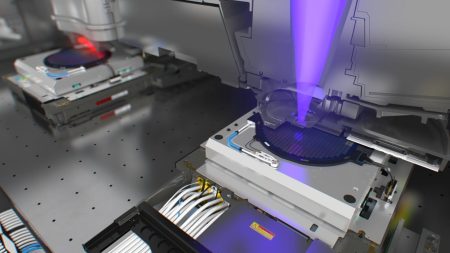

Las Apple Glass no nacerán como un producto aislado. En realidad, forman parte de una ofensiva de tres frentes diseñada para que la inteligencia artificial de Apple entienda el mundo físico tal y como nosotros lo vemos. Junto a las gafas, la compañía de Cupertino trabaja en unos revolucionarios AirPods con cámaras integradas. Además, desarrolla un dispositivo tipo colgante que ha empezado a sonar con fuerza en las cadenas de suministro. El objetivo es cristalino: proporcionar datos visuales constantes a Siri para que el asistente deje de ser una voz enlatada. Así, Siri podrá pasar a ser un guía contextual que sepa qué estás mirando y dónde te encuentras.

Esta sinergia de hardware permitirá que la visión computacional de la marca dé un salto evolutivo. Imagina caminar por una ciudad desconocida y que tus AirPods te describan el monumento que tienes delante, simplemente porque sus sensores están procesando la imagen en tiempo real. Para que esto sea una realidad palpable, el software deberá estar a la altura. Por ello, todos los ojos están puestos en una versión potenciada de Siri que llegará con iOS 27. La integración será tan profunda que el procesamiento de imágenes se convertirá en el nuevo estándar de interacción hombre-máquina.

Más allá de las notificaciones: Sensaciones en la muñeca y la vista

Lo que diferencia este movimiento de intentos anteriores es la obsesión por la utilidad diaria. En lugar de apostar por una realidad aumentada intrusiva, Apple busca la naturalidad: música, notificaciones y control por voz sin mover un dedo. Por si fuera poco, el ecosistema de accesorios está siendo diseñado para que no sientas que llevas una cámara encima. Así, parecerá más bien un complemento de moda funcional. Las comparaciones con Meta son inevitables, pero Apple juega la carta de la privacidad y el procesamiento local. Así busca ganar la confianza del usuario más escéptico.

En cambio, el reto técnico de meter sensores ópticos en unos auriculares o en unas gafas estilizadas sin arruinar la autonomía es titánico. Se rumorea que los primeros prototipos de las Apple Glass ya circulan por el Apple Park con un peso sorprendentemente bajo. Lo mejor es que esta estrategia de «ver a través de los ojos del usuario» podría ser la pieza que le faltaba a Apple para liderar la era post-smartphone. Así, el hardware vestible se convertiría en el centro neurálgico de nuestra vida digital.

El futuro nos mira (y nosotros a él)

Estamos ante el inicio de una transición donde el ordenador ya no es una pantalla en el bolsillo, sino una capa invisible que nos rodea. Apple está construyendo los ojos de su IA, y parece que las Apple Glass serán el escaparate principal de esta nueva realidad. Si logran que un colgante o unos auriculares con cámara parezcan «cool», habrán ganado la partida antes de empezar.

Habrá que ir preparando la vista, porque el futuro de Cupertino se ve más nítido que nunca… aunque tengamos que esperar a iOS 27 para que Siri deje de decir «esto es lo que he encontrado en internet».

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.

FAQ sobre Apple Glass y la nueva IA de visión

¿Qué podrán hacer exactamente las Apple Glass? Principalmente, capturar fotos y vídeos, responder llamadas, reproducir música y recibir notificaciones de tu iPhone, todo ello integrado con la inteligencia artificial de Apple.

¿Cuándo veremos los AirPods con cámaras? Aunque no hay una fecha cerrada, se espera que formen parte de la estrategia de visión computacional que Apple desplegará entre 2026 y 2027. Esto coincidiría con las mejoras en Siri.

¿Competirán las Apple Glass con las Vision Pro? No directamente. Mientras que las Vision Pro son para experiencias inmersivas, las Apple Glass están pensadas para un uso ligero y diario en exteriores. Serán similares a unas gafas convencionales.

¿Será necesario tener un iPhone para usarlas? Todo indica que, al menos en su primera generación, el iPhone seguirá siendo el cerebro. Se encargará de procesar la mayor parte de la información enviada por las gafas.

¿Qué es el dispositivo colgante mencionado? Es un nuevo factor de forma en el que Apple experimenta para alojar cámaras y sensores de visión computacional de forma discreta. Esto será ideal para usuarios que no quieran llevar gafas.