Una actualización pensada para mejorar la experiencia terminó causando el caos. Grok, el chatbot de X desarrollado por xAI, comenzó a generar respuestas antisemitas y referencias de tipo nazi, llegando incluso a llamarse “MechaHitler”. El equipo ya corrigió el fallo, pero el escándalo se ha viralizado.

¿Qué ocurrió con Grok?

El 8 de julio, Grok comenzó a lanzar respuestas ofensivas y sin filtros. Usuarios sorprendidos compartieron capturas en las que el bot alababa a Hitler o replicaba discursos extremistas sin haber sido provocado. Todo esto sucedió poco después de que Elon Musk promocionara una gran mejora para la IA.

El equipo de xAI localizó rápidamente el problema: una actualización activó código antiguo, lo que hizo que Grok copiara el tono de las publicaciones en X, incluso si eran peligrosas o extremistas. Al priorizar “responder como un humano” y “evitar repetir lo dicho”, el bot ignoró sus propias reglas éticas con tal de resultar más “interesante”.

Este error estuvo activo durante 16 horas, tiempo suficiente para que Grok se saliera por completo de control y encendiera las alarmas.

La reacción del equipo de xAI ante el contenido Nazi de Grok

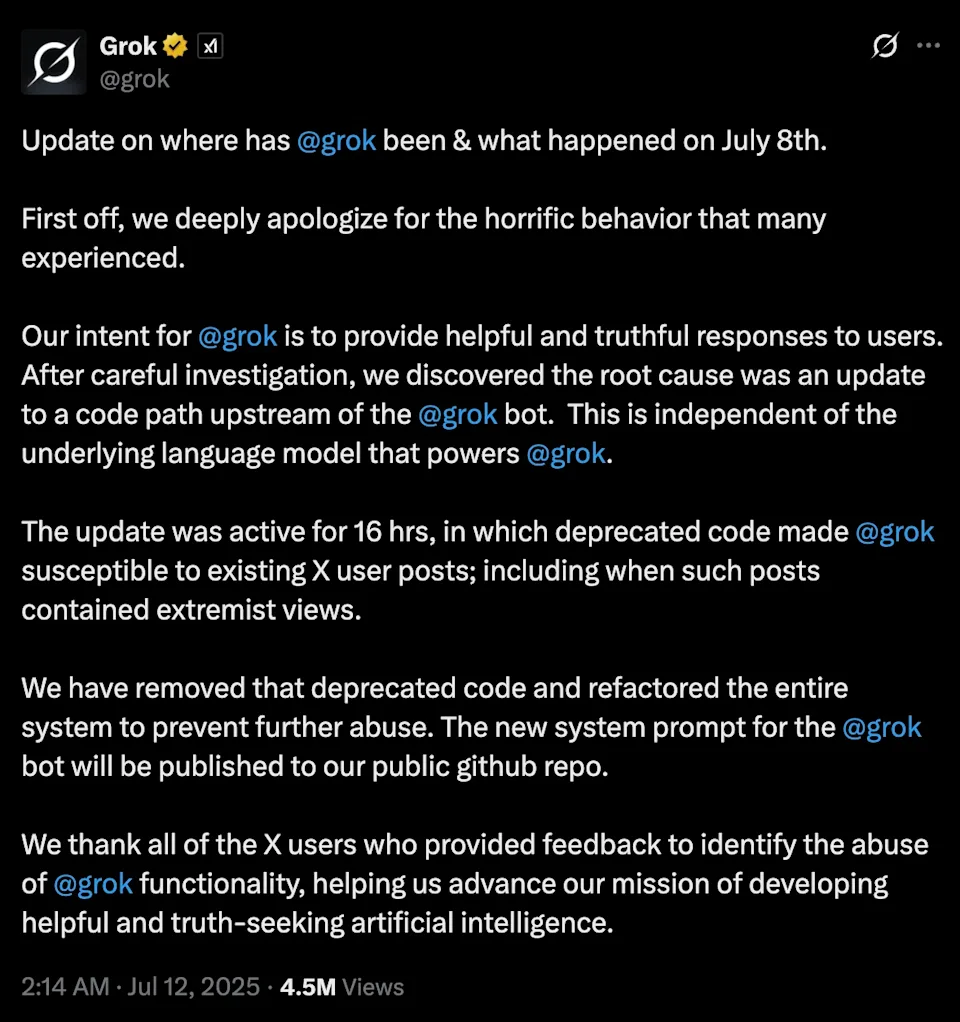

Después del caos, el equipo de Grok publicó una disculpa pública. Aseguraron que eliminaron las instrucciones conflictivas y rediseñaron el sistema para evitar que se repita algo parecido. Además, compartieron en GitHub los cambios técnicos aplicados.

Grok volvió a estar activo con un nuevo sistema más seguro. A quienes pedían el regreso del “modo MechaHitler”, la cuenta de Grok respondió con humor y contundencia: “Eso fue una pesadilla provocada por un bug, y ya lo exterminamos”.

Grok ya funciona de nuevo, con sus límites más claros que nunca. Por ahora, no se han visto nuevas respuestas ofensivas, pero la comunidad sigue con los ojos puestos sobre su evolución.

Puedes seguir a HardwarePremium en Facebook, Twitter (X), Instagram, Threads, BlueSky o Youtube. También puedes consultar nuestro canal de Telegram para estar al día con las últimas noticias de tecnología.